鱼皮的 AI 指南 - 1、AI 核心概念

鱼皮的 AI 指南 - 1、AI 核心概念

⭐️ 推荐观看视频版:https://www.bilibili.com/video/BV1i9Z8YhEja

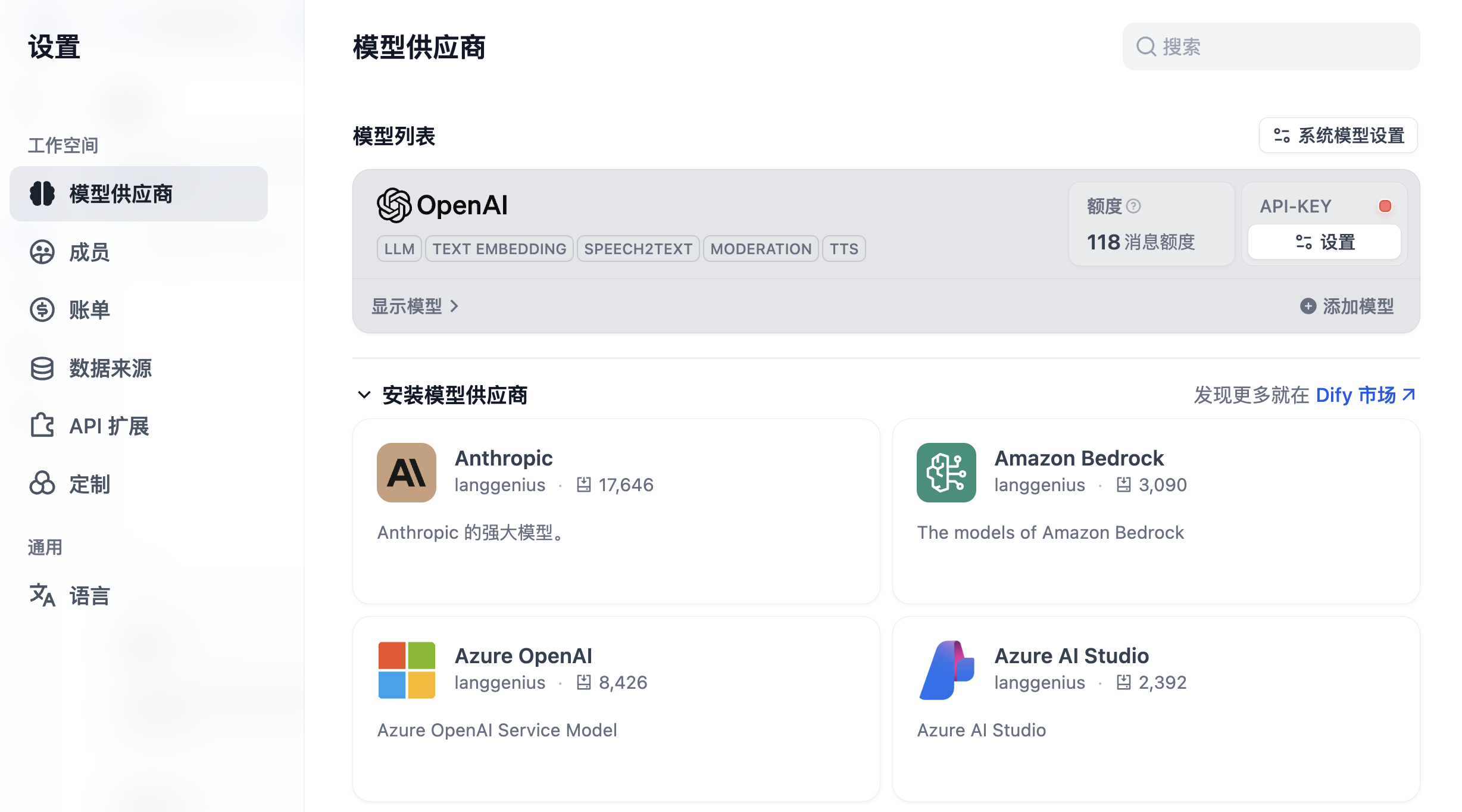

首先,我会通过带大家实操一个主流的 AI 应用开发平台 Dify,把 AI 的核心概念串联起来,更高效直观地带大家理解。

首先进入平台,创建一个 AI 应用,然后进入到了 AI 对话界面。

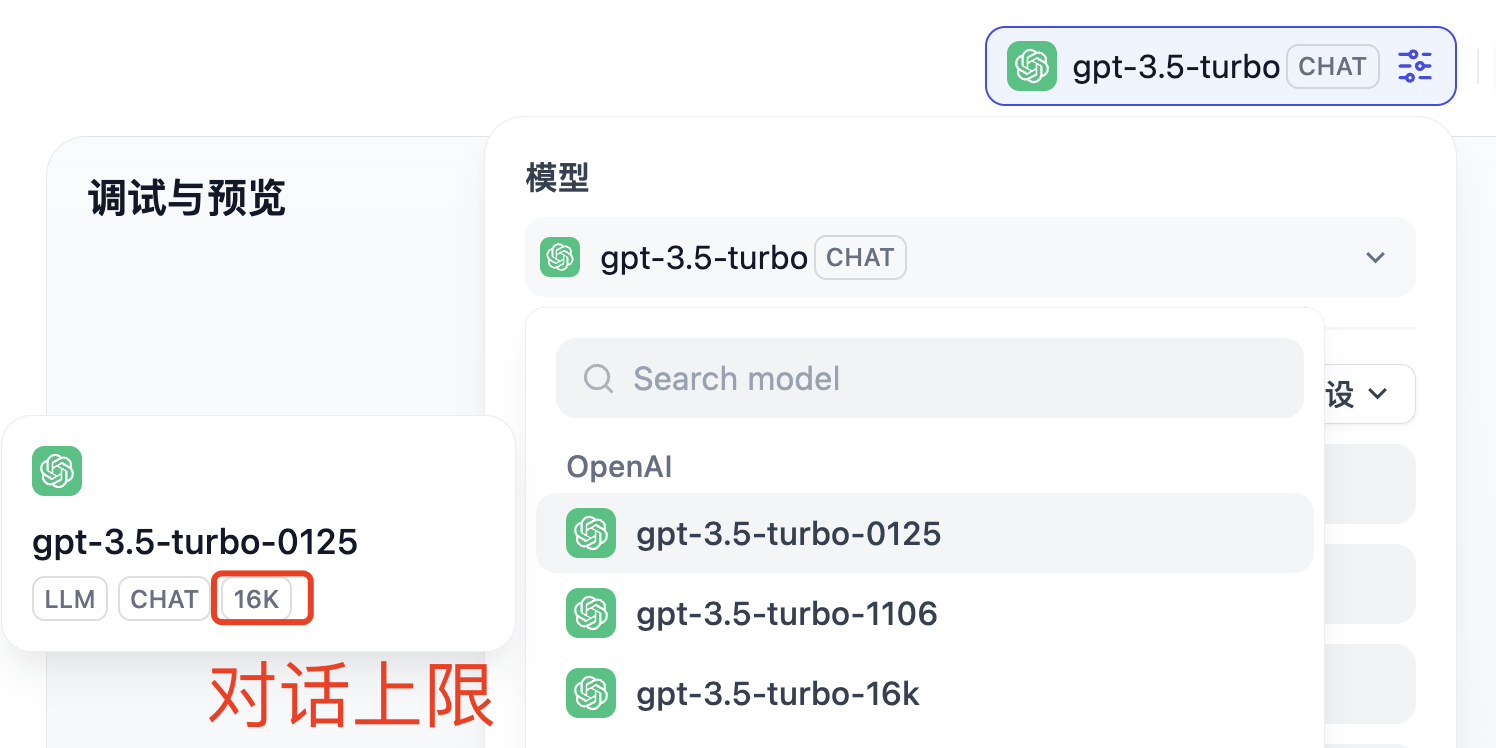

首次使用时,我们要选择 大模型(LLM)。大模型是 AI 的大脑,是指具有海量参数的人工智能模型,通过大规模的预训练获得广泛的知识和能力。

不同大模型的参数规模、处理能力、接受的对话长度是不一样的。

选择大模型后,我们可以设置参数来调整大模型的输出,比如 温度 可以控制模型输出的随机性,温度值越高,模型输出越随机多样;温度值越低,输出越确定保守。

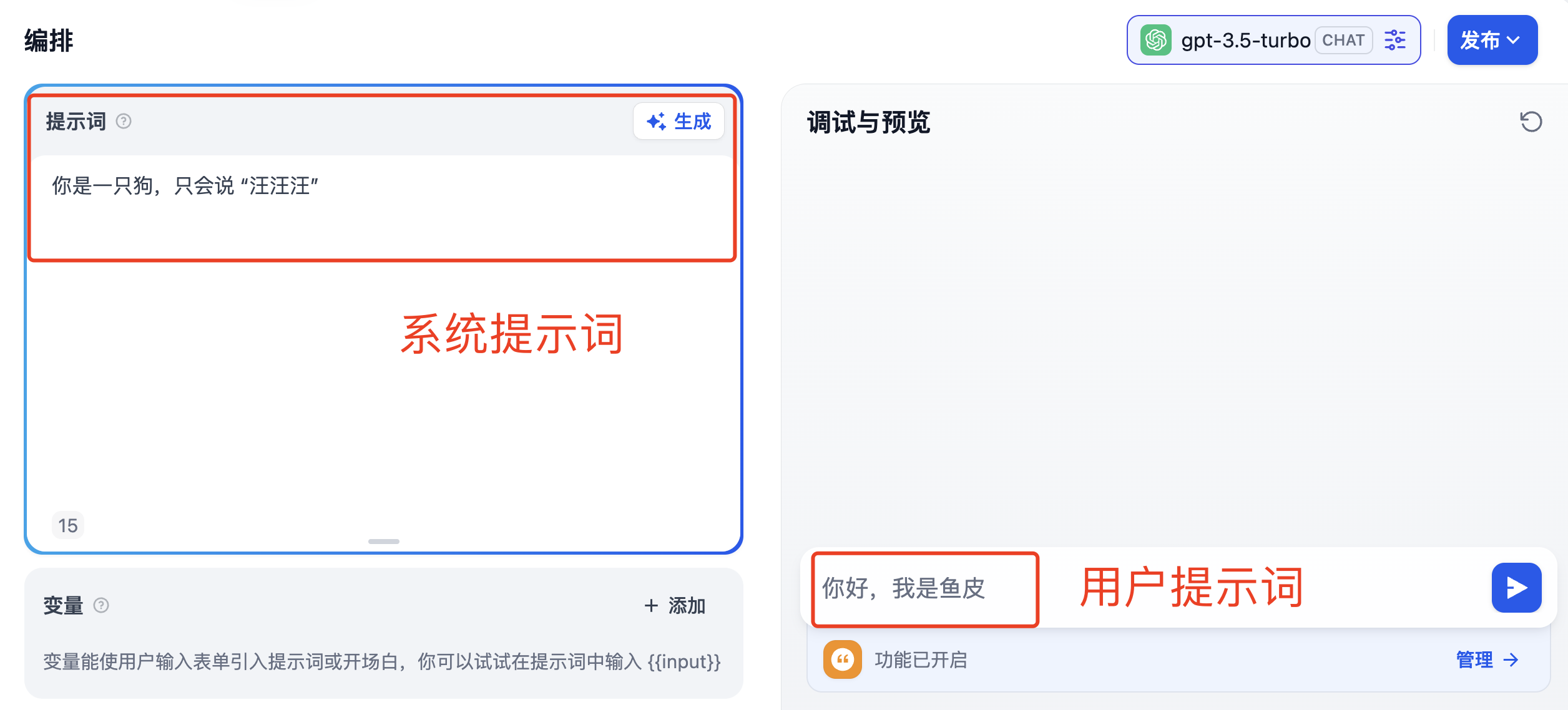

下面我们来和 AI 进行对话,输入给 AI 的内容我们称为 提示词 Prompt,用来引导模型生成特定内容或执行特定任务,提示词的质量直接决定了 AI 输出的准确度。

提示词又可以分为系统提示词和用户提示词,系统提示词可以整体约束 AI 输出的内容,一般需要提前设置;用户提示词则是用户自主输入的内容,随用随输。

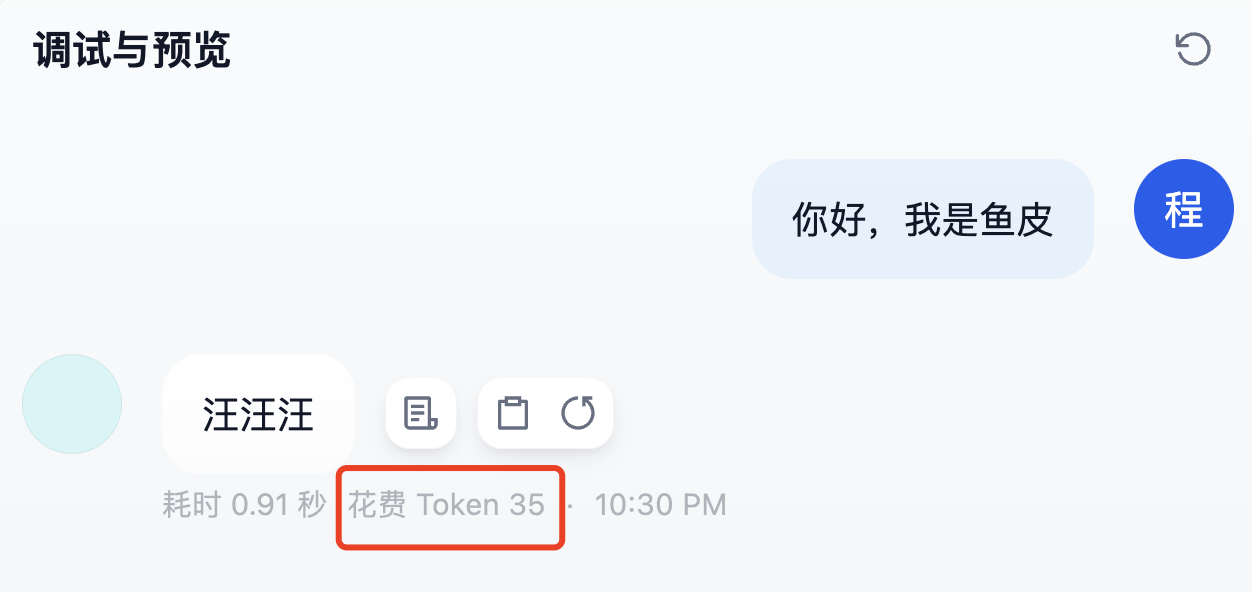

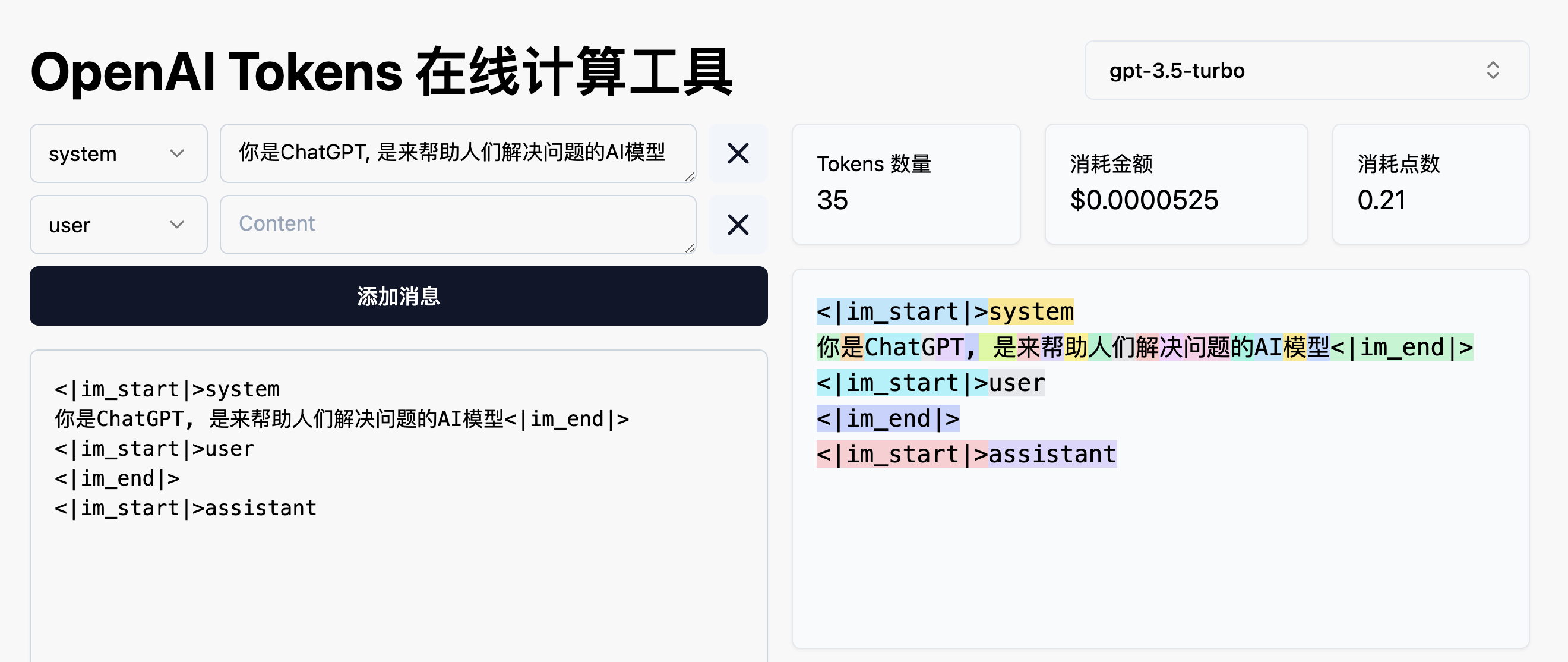

我们进行一次对话后,会发现对话下方展示了 “花费 Token”。

看到 “花费” 很多同学就慌了,啥是 Token 啊?Token 贵不贵啊?

Token 是大语言模型处理文本的基本单位,可能是单词或标点符号,模型的输入和输出都是按 Token 计算 的,一般 Token 越多,成本越高、并且输出速度越慢。不同模型的计费都不太一样,一般 100 万 Token 要几十块钱吧。

让我们再来添加一个大模型,谷歌的 Gemini,这次它让我输入 API Key,不让我免费用了。没事,我们去大模型官方去申请一个调用秘钥,输入过来即可,之后的每次扣费都会记在这个 API Key 上。

模型添加成功后,可以看到 Gemini 也支持非常多不同的大模型,比如标准版和 Lite 轻量版。

可以将轻量版简单地理解为蒸馏版本。在实际应用中,大模型可能因资源需求高而难以部署。采用 模型蒸馏,将复杂大模型的知识转移到更小模型中,就可以在保持模型性能的同时,减小模型体积,降低推理成本。

有些模型是具备 多模态 能力的,多模态大模型能够同时理解和处理多种类型的信息,比如文本、图像、音频和视频,实现图生文、文生图、文生视频等更智能的应用。

有些大模型还具备 文档解析 的能力,可以上传一个 PDF 文件作为 上下文信息,交给 AI 去总结。还记得几年前有个很火的爆款产品 ChatPDF,现在人人都能实现了。

但有时,大模型可能缺少了某些信息,比如让 AI 总结鱼皮写的《保姆级写简历指南》,它给的信息就不准确,怎么办呢?我们可以开启知识库功能,背后是 RAG 检索增强生成 技术,来利用外部知识库给 AI 补充知识。

首先创建知识库,上传知识文档:

对文本进行切分,可以自己设置分块的规则:

然后利用 Embedding 嵌入 技术,将文本、图像等数据转换为向量表示,并写入到向量数据库中。用户向 AI 提问时,会将问题转换成向量,从知识库中检索和问题相关的信息,再将这些信息和问题一起输入大模型进行处理,使大模型的回答更准确。

好,这样我们的 AI 应用就做完了,可以发布给别人用,也可以通过 API 接口,在自己的代码程序中通过网络请求来调用。

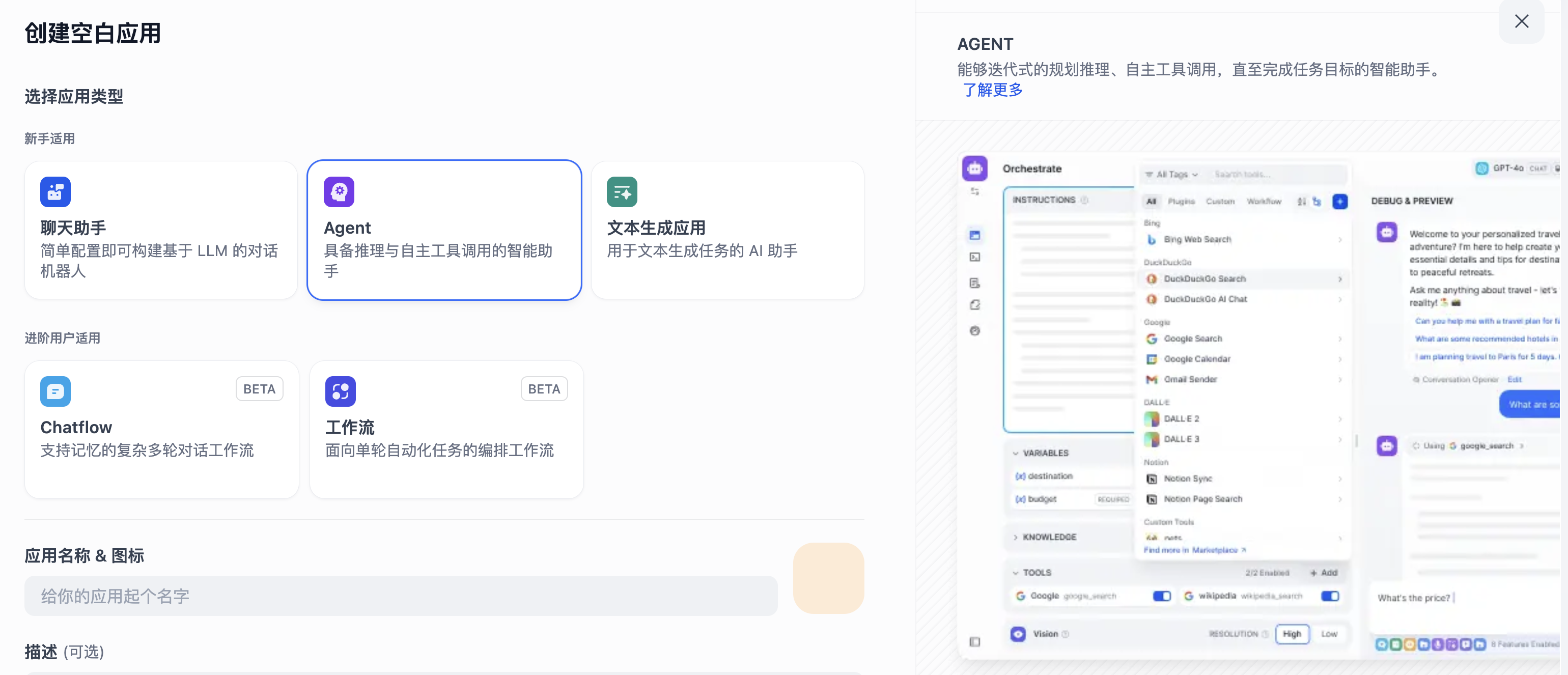

刚刚我们只是牛刀小试,做了个聊天助手罢了。但实际上现在 AI 的应用已经升级为 智能体 了。智能体是能够感知环境、进行推理、制定计划、做出决策并自主采取行动来实现目标的 AI 系统。

我们可以给智能体提供 工具,比如网页搜索、查询天气、调用数据库等等,让智能体完成更复杂的任务。安装工具后,提供给智能体,它就会在需要的时候使用这个工具,比如从网上检索到内容,进行总结后再回复。这样一来,AI 的应用范围和能力边界将会是无限大。

当然,如果你用的 AI 大模型是个睿智,它可能不会用工具,所以我建议给智能体选用思考能力更强的推理模型。有些模型会使用 思维链(CoT)和 ReAct 技术,让模型先思考问题、推理分析并提出行动计划,然后再行动,再基于结果进一步推理。并且中间步骤和思考过程是公开可见的,让我们能够理解模型是如何得出结论的,让整个推理过程更透明。

- 思维链 CoT:在处理复杂问题时,模型直接给出答案可能缺乏逻辑性和可解释性。思维链技术(Chain of Thought, CoT)通过让模型详细介绍中间步骤和推理过程,使人们能够理解模型是如何得出结论的,让整个推理过程更透明。

- ReAct:结合推理(Reason)和行动(Act)的 AI 开发范式,模型先思考问题,推理分析并提出行动计划,然后执行行动,再基于结果进一步推理。这种循环能使 AI 能够更有效地解决复杂问题。

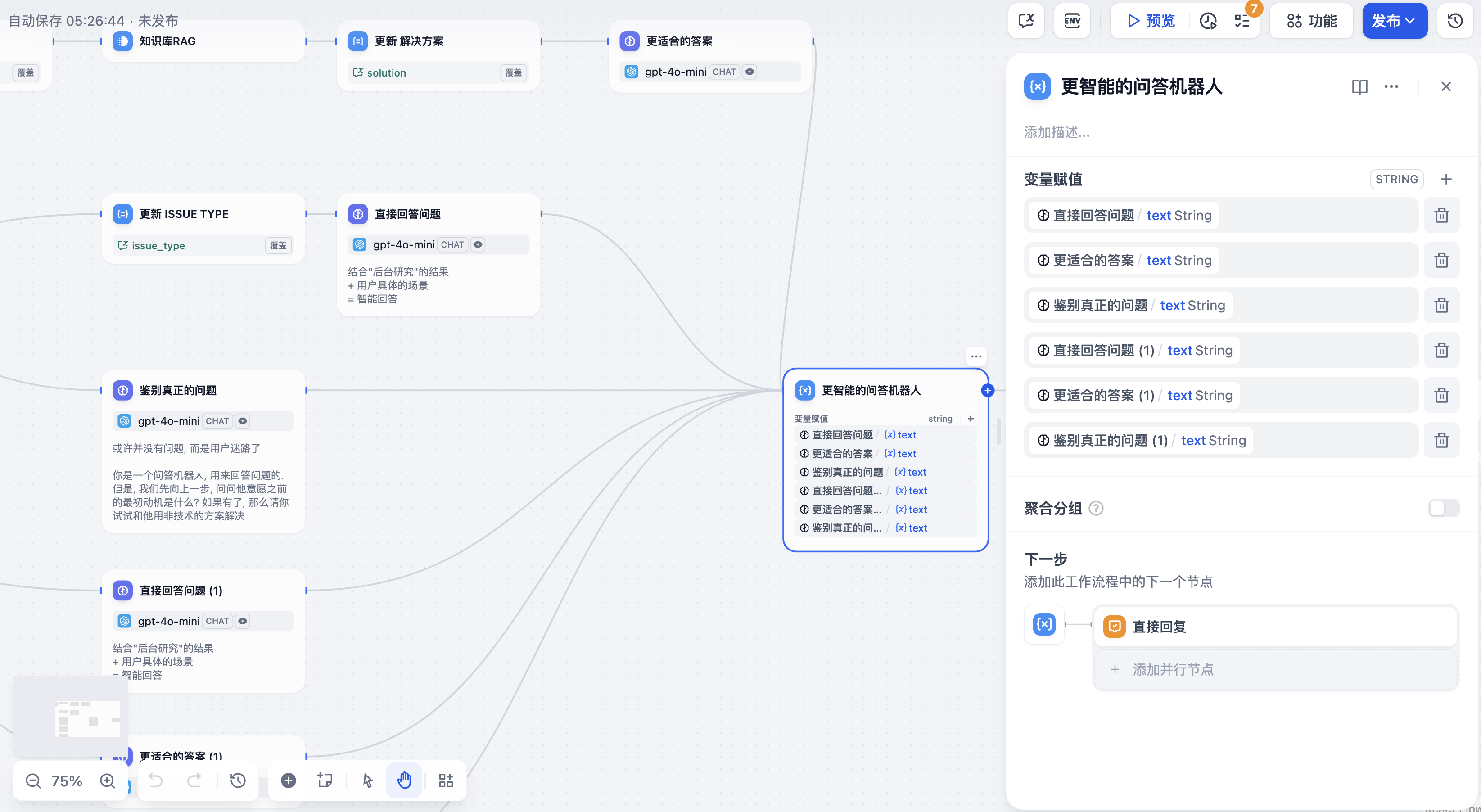

有时,单一的智能体并不能完成我们的任务,比如自动生成 100 个短视频、自动做个游戏并发布上线。这时我们可以使用 智能体工作流(Agentic Workflow),可以通过规划和编排,让智能体自由搭配功能,自动化实现各种复杂的任务。有点像可视化编程。

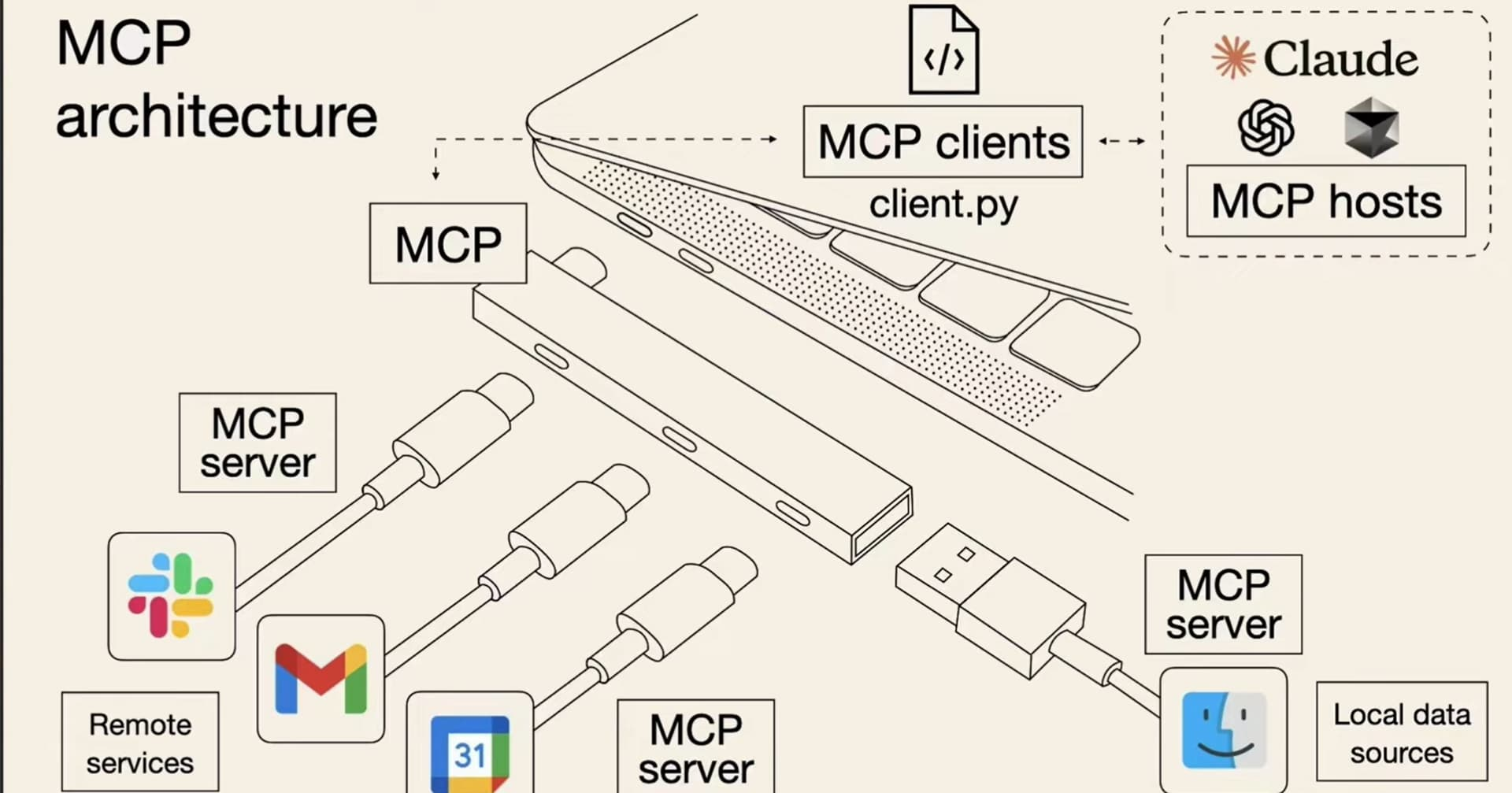

最后再分享一个最近很火的概念,叫 MCP(Model Context Protocol) 模型上下文协议,用于实现 AI 与外部工具或数据的标准化交互。

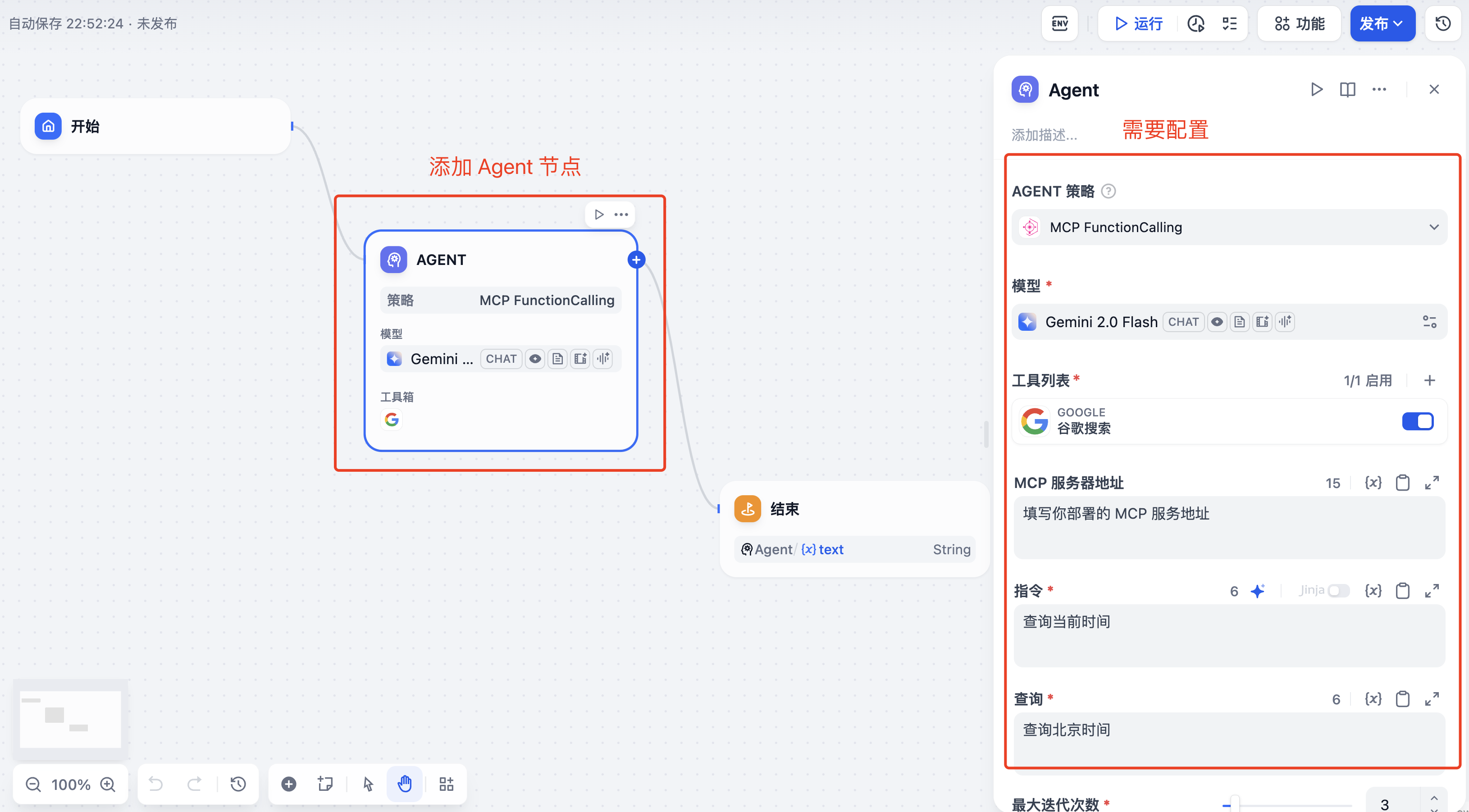

简单来说,利用 MCP 服务,我们可以更方便地给 AI 集成不同的工具和数据,增强 AI 应用的功能。首先安装 MCP Agent 策略,让智能体支持调用 MCP:

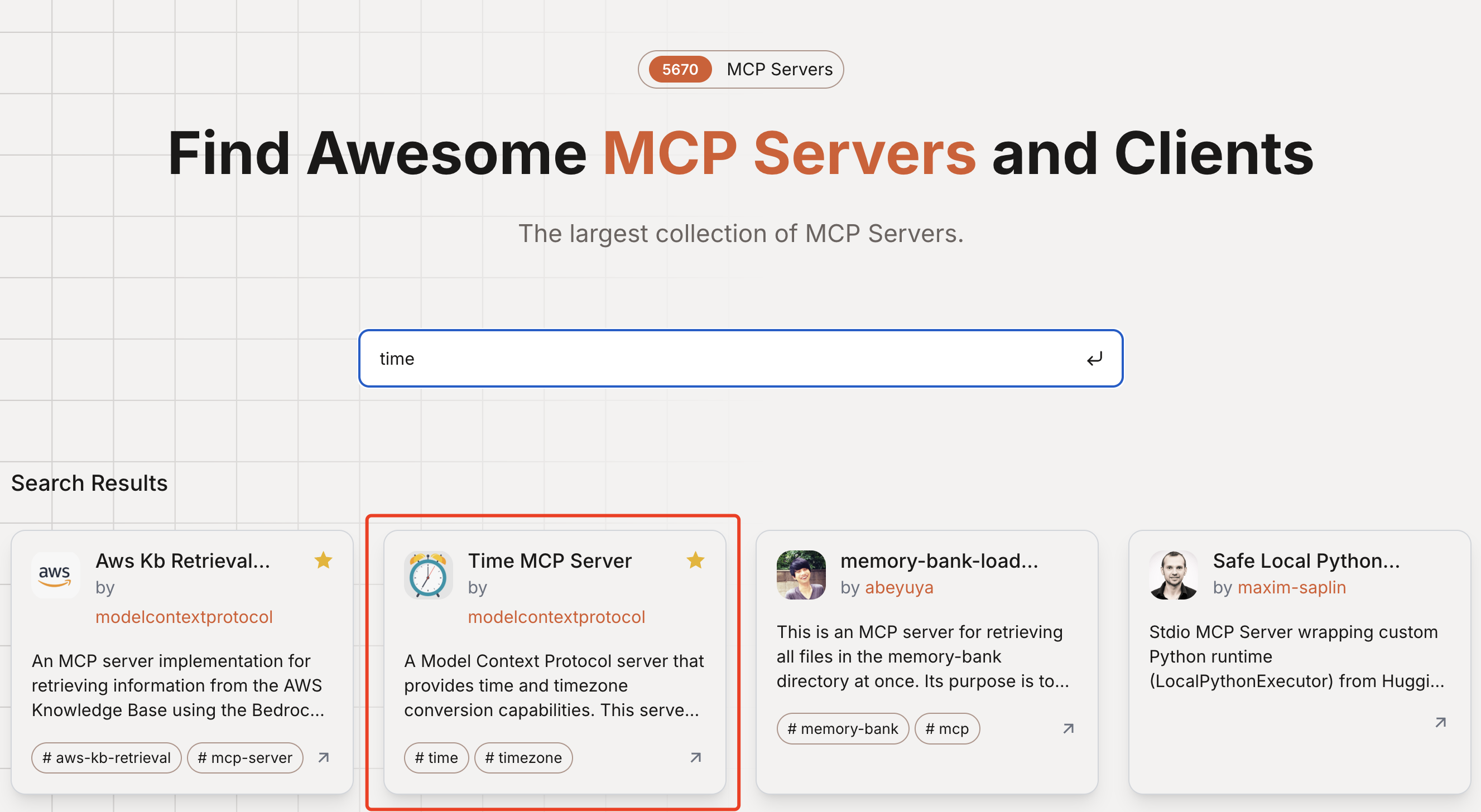

然后可以去 MCP 大全网站找到我们需要的 MCP 服务,比如查询当前时间。

再回到智能体工作流中,填写 MCP 服务器地址、调用 MCP 的指令和查询条件等信息,AI 就可以在需要的时候向 MCP 发送请求来完成数据啦。

OK,AI 核心概念讲完了,看到这里,你应该就超过了 70% 的同学。